6 Gedanken zum möglichen TikTok-Verbot

Joe Biden hat das Gesetz tatsächlich unterschrieben. Aber jetzt geht das Drama erst richtig los.

Joe Biden hat das Gesetz tatsächlich unterschrieben. Aber jetzt geht das Drama erst richtig los.

Die USA stellen TikTok vor die Wahl: Verkaufen oder verboten werden. Es geht um 170 Millionen Menschen und Dutzende Milliarden Dollar.

Einen Monat lang war die Debatte um ein mögliches TikTok-Verbot aus den Schlagzeilen verschwunden. Bis jetzt.

KI kann nicht nur Texte generieren, sondern täuschend echte Avatare. Sind virtuelle Influencerïnnen die Zukunft?

Texte wie dieser könnten bald viel wert sein. Weil ihn kein Sprachmodell zusammengesetzt hat, sondern ein Mensch.

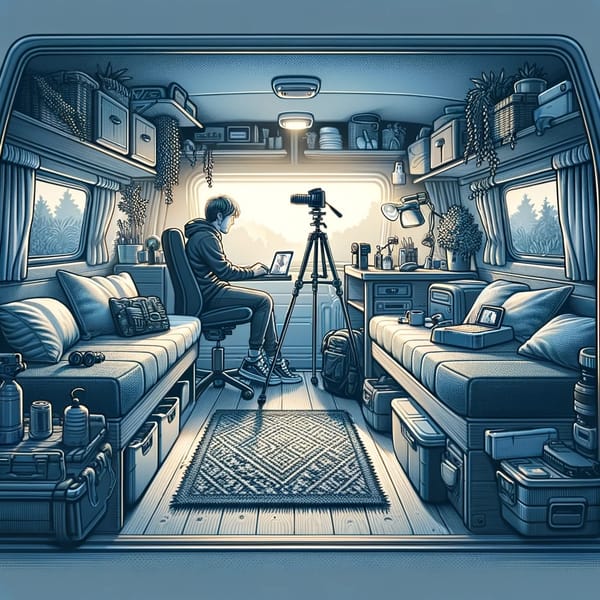

Für Bewegtbild im Netz gilt seit Jahren: viele Schnitte, ständig Action, bloß kein Stillstand. Diese Erfolgsformel könnte bald passé sein.

Texte? Schreibt KI. Töne? Erzeugt KI. Bilder? Erfindet KI. Videos? Ratet mal. Allmählich zeichnet sich ab, wie ein Internet aussieht, in dem synthetische Inhalte überhandnehmen – und was dadurch verloren gehen könnte.

Über keine große App ist so wenig bekannt wie über Telegram. Doch jetzt denkt Gründer Pavel Durov über einen Börsengang nach – und dann wäre Schluss mit der Verschwiegenheit.

Während das TikTok-Verbot in den USA leicht ins Stocken geraten ist, rückt die App in Deutschland zunehmend in den Mittelpunkt.